Umetna inteligenca: v središču naj bo človek

Pandemija je nedvomno pospešila razvoj in uporabo umetne inteligence ter spremenila tudi naš odnos do te tehnologije. Pred leti bi marsikje z zadržanostjo sprejeli robote na javnih prostorih, a danes jih najdemo celo v vrtcu v Španiji, kjer otrokom merijo temperaturo, v restavraciji v Južni Koreji, kjer strežejo hrano in pijačo, po indijskih bolnišnicah, kjer se sprehajajo z zaslonom v trebuhu, da omogočijo bolnikom komunikacijo s svojci, v Frankfurtu pa v nakupovalnem središču razlagajo preventivne ukrepe v boju s covidom 19.

Prizor iz kratkega filma Slaughterbots. Vir: Kanal Future of Life Institute, posnetek zaslona

A prisotnost umetne inteligence ni vedno tako zaznavna, otipljiva in vidna, kot so ti roboti. V naša življenja posega globoko in neopazno, saj je z nami vsak dan, pa če se tega zavedamo ali ne; na primer s priporočili pri spletnem nakupovanju in oglasih, ki nam jih strani servirajo, s podajanjem relevantnih rezultatov v iskalnikih, pri ugašanju luči v pametnem domu pa tudi v zdravstvu, prometu, proizvodnji, kmetijstvu, javni upravi in seveda v vojski. A v letu 2020 je njena uporaba izzvala tudi upor proti algoritmu, ki je zaznamoval celotno generacijo.

»Fuck the algorithm«

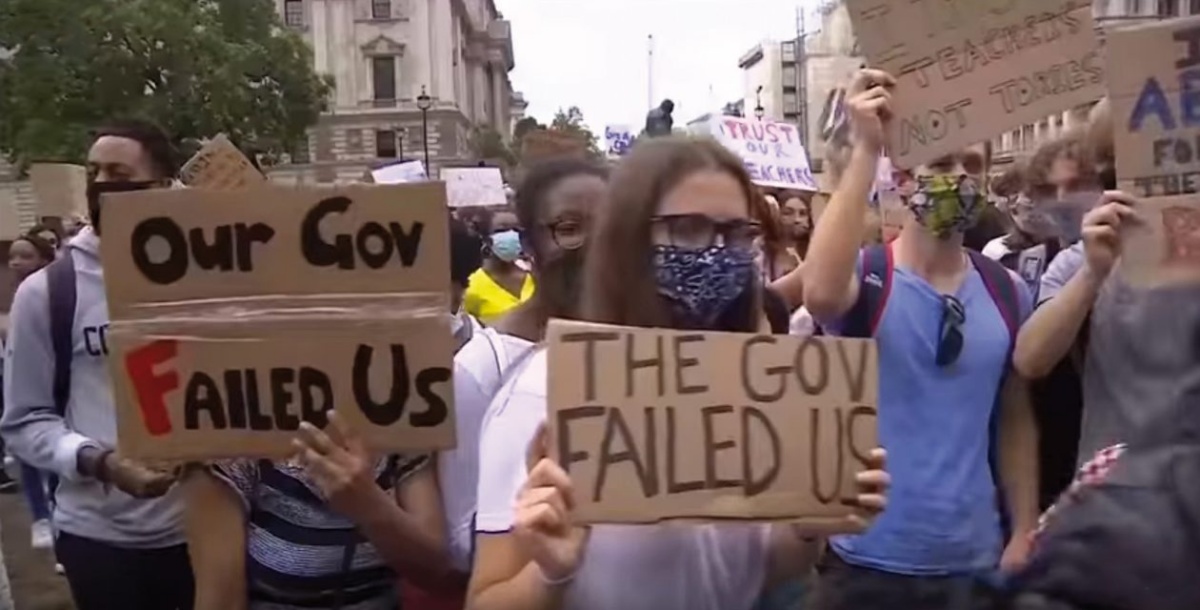

Zaradi epidemije v Veliki Britaniji letos niso izvedli srednješolskih zaključnih izpitov (A-level in GSE, podobno kot naša matura) in tako so odločevalci izbirali med dvema možnostma. Ali naj zaključno oceno šolanja brez teh izpitov podajo učitelji ali algoritmi? Izbrali so zadnjega.

Pri približno tretjini dijakov je algoritem predvidel nižjo oceno kot njihovi učitelji, ki so jo podali tudi na osnovi prejšnjih ocen in ocen poskusnih izpitov. Kmalu je postalo jasno, da je algoritem dijake zasebnih šol ocenil bolje kot tiste iz javnih, ki jim je pogosto dodelil eno oceno manj kot učitelji. Časopis The Washington Post tako navaja primer dekleta Maimune Hassan, ki je na poskusnih izpitih dobila dve najvišji oceni in eno drugo najvišjo, a ji je algoritem toliko zbil ocene, da ne bi dobila mesta na dveh prestižnih univerzah, ki bi ji bili glede na poskusne izpite zagotovljeni. Ocena algoritma je namreč na koncu upoštevala tudi renome šole oziroma pretekle rezultate izpitov in je tako dala prednost elitam, prikrajšani pa so bili odlični dijaki javnih šol. Dijaki so šli na ulice s sloganom »fuck the algorithm«. Po protestih in uporu javnosti so odločevalci za napako okrivili algoritem, upoštevala pa se je tista ocena, ki je bila višja. A takšen odziv generacije in vladni korak nazaj sta bolj izjema kot pravilo, saj umetna inteligenca v vrtinec predsodkov in diskriminacije pogosto potegne nepovezane posameznike.

Michele Gilman z univerze v Baltimoru že 20 let dela kot odvetnica in pogosto zastopa revne. Včasih toži državne institucije, drugič lastnike stanovanj, ampak zadnje čase je po njenih besedah vsaka pritožba povezana z algoritmom, večina sprememb, ki so privedle do težave, pa nevidnih oziroma nepojasnjenih. Algoritmi namreč odločajo o marsičem, a kot za MIT Technology Review razlaga Gilmanova, se ljudje tega sploh ne zavedajo, a ko se znajdejo v njihovi nemilosti, si težko opomorejo. Seveda so med ZDA in Evropo velike razlike, podatki so tam veliko bolj povezani, kreditna sposobnost vpliva na bivalno situacijo, zaposlitev, itd., prav tako podjetja, ki pripravljajo oceno kreditne sposobnosti za vzpostavitev te uporabljajo množico podatkov, med drugim javno dostopne podatke, bančne aktivnosti in družabna omrežja, kar v Evropski uniji (za zdaj) ni legalno izvedljivo. Gilmanova razlaga, da pravzaprav obstajata dve algoritemski mreži, ena je vezana na kreditno sposobnost, druga pa na državne službe; prva odloča o nakupu avta, domu in zaposlitvi, druga o zdravstvu in socialnih transferjih. Glavni problem pa povzroča netransparentnost sprememb v sistemih, saj tudi odvetniki pogosto ne vedo, zakaj je neki posameznik izgubil kakšno pravico. Kot primer vrtinca, v katerega se ujamejo posamezniki, MIT Technology Review navaja družino, v kateri je eden od članov izgubil delo in zaradi napake avtonomnega sistema ni dobil nadomestila za brezposelne. Družina je zamujala z najemnino, zato jih je lastnik tožil, tožba bo zapisana v javnih podatkih in bo šla med nabor podatkov algoritma, zato bo družina v prihodnosti še težje prišla do dobrega stanovanja. Če ne bodo pravočasno plačali najemnine in stroškov, pa lahko to vpliva tudi na njihovo kreditno sposobnost.

Gilmanova opozarja, da gredo vsi skozi ta sistem, a da ta pogosteje krati pravice revnih in manjšin. Seveda predsodki algoritmov in umetne inteligence niso novost, a avtonomni sistemi, torej sistemi, ki so sposobni sami sprejemati odločitve, v nekem trenutku odločajo tudi o življenju in smrti, ob tem pa na vseh področjih manjka transparentnosti in odgovornosti.

Vojska brez ljudi

Po poročanju časopisa The Guardian se na področju vojske med drugim vlaga v brezpilotne drone, ki avtonomno delujejo v rojih, ne kot posamezne naprave. Spomnimo se kratkega videa Slaughterbots, ki ga je leta 2017 kot svarilo pred avtonomnim smrtonosnim orožjem (LAW) predstavila organizacija Future of Life Institute. V njem možakarja iz kombija izpustita roj dronov, ki nato selektivno napadejo tarče na fakulteti. Ta scenarij je bliže, kot bi si drznili misliti.

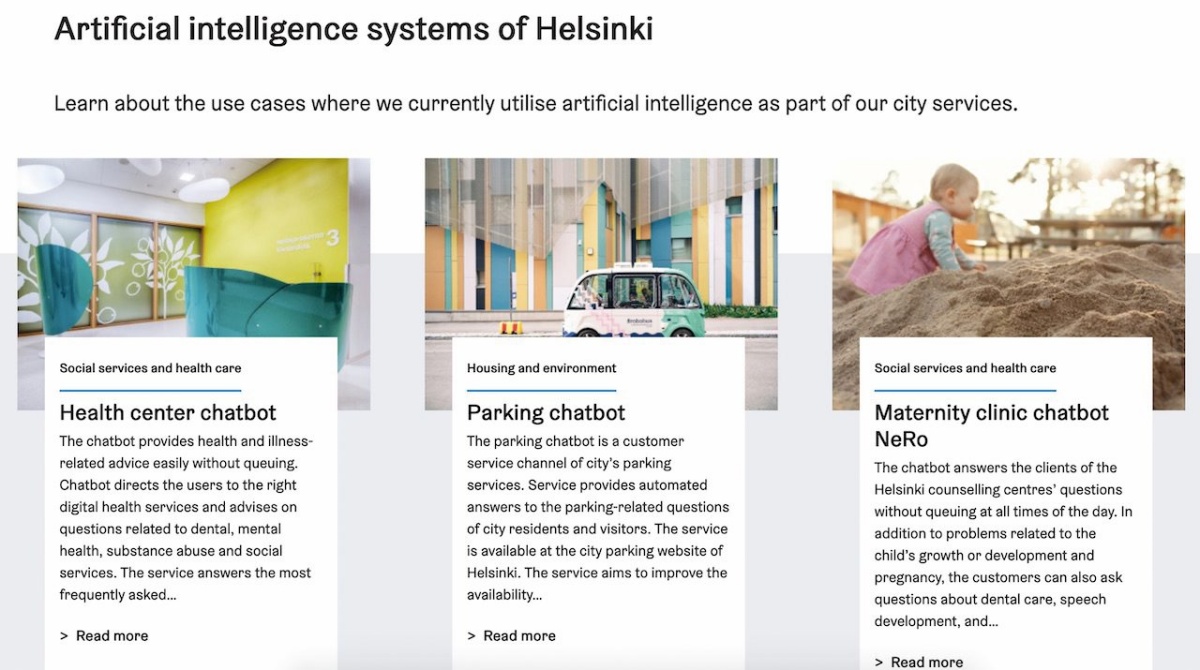

Seznam storitev v Helsinkih, ki so zagotovljene z umetno inteligenco. Vir: Spletna stran mesta Helsinki, posnetek zaslona

V vojski je umetna inteligenca razumljivo dobrodošla, njeno uporabo pa upravičuje tudi ohranitev človeških življenj. A kot je za časopis The Guardian izjavil profesor Noel Sharkey, član Campaign Against Killer Robots, je nemogoče programirati robota z odzivi na neskončno število situacij, ki se lahko zgodijo na bojišču. Problemi se pravzaprav pojavijo že pri učenju, saj za strojno učenje potrebujemo ogromno količine podatkov, te pa sistemi pridobijo le na bojišču, hkrati pa izkušnje puščavskega bojišča ne bodo posebej relevantne v džungli.

K prepovedi razvoja avtonomnega smrtonosnega orožja je s številnimi znanstveniki pozival tudi Stephen Hawking, delu z vojsko pa so se uprli tudi zaposleni pri Googlu, kjer so, kot je za The Guardian povedala nekdanja zaposlena Laura Nolan, želeli, da za vojsko ustvarijo umetno inteligenco, ki bi pohitrila tehnologijo prepoznave posnetkov. Ta bi lahko čim hitreje razlikovala med ljudmi in predmeti, tako ne bi potrebovali velikega števila zaposlenih za pregledovanje materialov. A kot pravi Nolanova, bi moral vsak tak vojni stroj biti pod strogim nadzorom, saj algoritme hitro kaj vrže iz tira. Oboroženo skupino lovcev lahko hitro prepoznajo kot sovražno četo, povsem pa jih lahko zmede nepredvidljivo vreme, ki vpliva na vidljivost in razpoznavnost. Če so stvari pod človeškim nadzorom, nekdo nosi odgovornost, a pri takšnih vojaških rešitvah lahko avtonomni sistemi pomotoma sprožijo vojno ali pa, denimo, zadenejo nuklearko. Tveganje vsekakor ni majhno. Zanemarljivo pa ni niti dejstvo, da lahko takšne rešitve pridejo tudi v roke kriminalnih združb in terorističnih organizacij.

Konsenza o prepovedi za zdaj še ni, a v preteklosti so države s skupnimi močmi že prepovedale škodljiva in grozna orožja, kot so biološka in kemična ali kopenske mine. Pozivi k prepovedi ubijalskih robotov oziroma orožja, ki lahko posreduje in ubije brez neposrednega človeškega nadzora (LAWS), so stalnica, a Peter Warren Singer iz ameriškega možganskega trusta New America se po drugi strani zavzema za regulacijo, pri čemer bi avtonomni roboti lahko, na primer, patruljirali po puščavi, kjer bi lahko celo koga ustavili, a odločitev o tem, ali naj streljajo, bi ostala v rokah človeka.

Protesti mladih v Veliki Britaniji. Vir: Kanal BBC News, posnetek zaslona

Kam gremo?

Želeli bi si, da čim dlje od morilskih robotov, a v tej dobi smo ljudje pred negotovo prihodnostjo, saj bodo zaradi umetne inteligence izginjala delovna mesta. Na drugi strani se bodo odpirala nova, a bodo zahtevala nove veščine in znanja. Svoboščine, pravice in zasebnost bodo še naprej na preizkušnji, saj lahko v bližnji prihodnosti pričakujemo še več sprememb. Podjetja se za spremembe v delovanju pogosto odločajo po šokih – kot je pandemija –, ko poskušajo prihraniti pri stroških dela, kar bi lahko zelo verjetno vodilo v razcvet umetne inteligence v naslednjih letih.

V EU se pomikamo k spodbujanju investicij v umetno inteligenco pa tudi k skupnim etičnim standardom. Člani Evropskega parlamenta so oktobra sprejeli predloge, Komisija naj bi zakonodajni predlog podala v začetku leta 2021. Iniciativo pa so že prevzela nekatera mesta, kjer so se letos odločili za transparenten pristop. Tako so v Amsterdamu in Helsinkih objavili beta register algoritmov, ki jih mesti uporabljata pri zagotavljanju nekaterih storitev. V registru so navedeni nabor podatkov, prek katerih so učili model, opis uporabe algoritma, ocena potencialnih tveganj, podatki o nadzoru, prebivalci pa lahko podajo tudi povratne informacije oziroma najdejo kontaktne podatke odgovorne osebe, ki skrbi za to storitev, če menijo, da delovanje algoritma negativno vpliva nanje. V Amsterdamu preverjajo parkirana vozila, saj je število avtomobilov v mestu omejeno, medtem ko v Helsinkih z uporabo algoritmov priporočajo knjige, upoštevajoč posameznikov interes in povratne informacije.

Naj bosta transparentnost in odgovornost ključni tudi v prihodnjem letu.