Algoritmi vam bodo snedli obraz

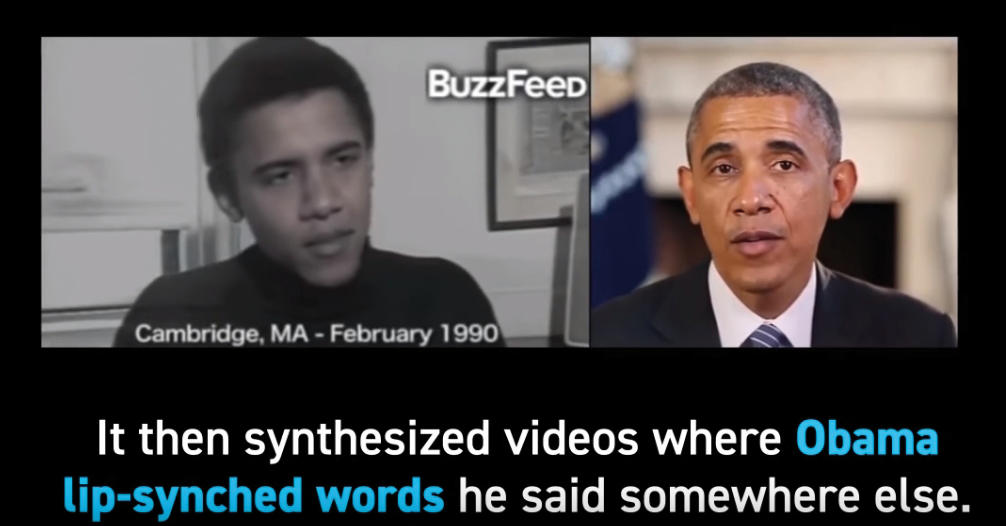

Poleti 2017 so raziskovalci z ameriške univerze Washington v spletu objavili posnetek govora nekdanjega predsednika Baracka Obame. Govor je bil resničen, obraz Baracka Obame pa ne. Raziskovalci so namreč iz vsem dostopnih videoposnetkov njegovih govorov sestavili prepričljiv vizualni model njegove podobe in jo uporabili za reprodukcijo njegovih javnih nastopov.

Po smrti igralke Carrie Fisher so se morali ustvarjalci filma Vojna zvezd: Poslednji jedi potruditi in v že posneto videogradivo pokojne igralke vdelati nove posnetke njenega govora, ki so ga dobili iz že posnetega gradiva. Ko so se lani poleti začele širiti govorice, da bodo v prihodnjih filmih serije Vojna zvezd lik princese Leie enostavno digitalno poustvarili, so predstavniki producentske hiše LucasArts to javno glasno zanikali.

Zvezdnica filma Wonder Woman, Gal Gadot, v pornografskem filmu. Pornografski film je bil resničen, obraz izraelske filmske zvezde pa ne.

Decembra 2017 je po spletu zaokrožil posnetek zvezdnice filma Wonder Woman, Gal Gadot, v pornografskem filmu. Pornografski film je bil resničen, obraz izraelske filmske zvezde pa ne. Neznani uporabnik je namreč z algoritmi preprosto vdelal njen obraz na obraz neznane pornografske zvezde, rezultat pa je bil za spletni video nižje kakovosti izredno prepričljiv.

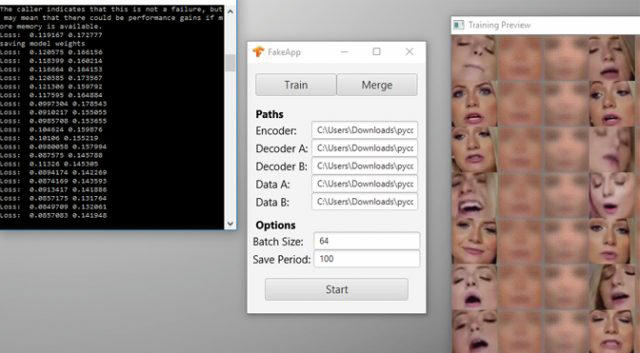

Ko so na prehodu v leto 2018 uporabniki spletnega omrežja Reddit objavili enostavno orodje, ki uporablja algoritme za vdelavo obrazov na tuja telesa, se je število lažnih posnetkov dobesedno razbohotilo.

Nekateri uporabniki so orodje vzeli humorno in začeli lepiti obraz igralca Nicholasa Cagea na telesa znanih igralcev filmskih klasik, kot so Indiana Jones, Superman in Terminator, drugi so z orodjem zamenjali obraze politikov (najbolj priljubljen je bil seveda Adolf Hitler), tretji pa so se začeli ukvarjati s pornografskimi posnetki znanih igralk, kot sta Daisy Ridley in Jessica Alba.

A če se vam zdijo lažni posnetki Nicholasa Cagea smešni (tega res ni mogoče zanikati), so posledice v drugih primerih veliko hujše. Predstavljajte si, da po spletu zaokroži lažni posnetek politika, ki mu besede v usta polaga nekdo tretji. Ali pa pornografske posnetke, v katerih nastopajo ljudje, ki se s tem nikoli niso strinjali.

Ko vam stroj ukrade dušo

Postopek generiranja lažnih fotografij in videoposnetkov se začne z učenjem algoritmov. Raziskovalci mu iz velikih zbirk podatkov določijo ključne besede, ki te fotografije opisujejo, nato pa algoritmu prepustijo, da na podlagi naučenega ustvari nekaj novega. Rezultati so naravnost šokantni, raziskovalci pa opozarjajo, da bo z vedno zmogljivejšo strojno opremo generiranje novih posnetkov in slik toliko lažje in hitrejše.

Seveda se raziskovalci ukvarjajo s pozitivnimi primeri kreativne industrije (filmi in videoigre), kjer bodo lahko algoritmi pomagali oblikovalcem in programerjem pri ustvarjanju svetov, obenem pa se ljudem ne bo treba ukvarjati z zamudnim ustvarjanjem končnega izdelka.

»Področje se zelo hitro razvija,« je za The Verge pred dvema letoma izjavil Jeff Clune, profesor informatike na univerzi v Wyomingu, kjer se ukvarjajo z učenjem algoritmov. »Vsakič znova sem presenečen nad rezultati svoje ekipe, ki ob pomoči algoritmov iz nič ustvari podobe iz vsakdanjega sveta,« dodaja.

Več obrazov digitalnega izsiljevanja

Ena najosnovnejših in obenem najbolj bolečih rab pornografije v slabe namene je t. i. maščevalna pornografija (t. i. revenge porn).

V prvem primeru gre za nekdanje partnerje v razmerju, ki se zaradi razlogov odločijo, da bodo intimne posnetke in fotografije partnerja delili v svetovnem spletu, oziroma bodo z njimi partnerja izsiljevali. Posnetki nato krožijo po družabnih omrežjih, elektronski pošti in različnih spletiščih, med katerimi se nekatera specializirajo prav za objavo takih vsebin.

Drugi način izsiljevanja s pornografskimi posnetki (t. i. sextorsion) so dekleta spletnih kamer (t. i. webcam girls), ki z žrtvijo najprej vzpostavijo pristen stik in pristanejo na kibernetski seks, nato pa posnetke gole žrtve izkoristijo za izsiljevanje.

Tretji način so vdori v vaše telekomunikacijske naprave, kjer hranite intimne posnetke. Izsiljevalec nato žrtev izsiljuje z grožnjami objave teh posnetkov v spletu, oziroma prepošiljanje posnetkov ljudem, ki jih ima žrtev v svojem telefonskem imeniku.

Projekt Varni na internetu, ki teče znotraj slovenskega nacionalnega odzivnega centra za obravnavo incidentov s področja varnosti elektronskih omrežij in informacij že dalj časa opozarja na vse zgoraj naštete primere in svari, da so več takih načinov izsiljevanja zaznali tudi v slovenskem spletu.

Lažni pornografski videoposnetki (t. i. deep-fakes) predstavljajo nov način uporabe umetne inteligence in algoritmov z zelo problematičnimi posledicami. S pomočjo programske in strojne opreme lahko namreč skoraj vsak uporabnik svetovnega spleta v pornografske posnetke vdela obraz žrtve in jo tako začne izsiljevati.

Trenutno so na udaru predvsem znane osebnosti – igralci, politiki in športniki. Ker je vizualnega gradiva z njihovo podobo v spletu zelo veliko, ima algoritem na voljo veliko količino podatkov, s katerimi lahko operira pri vdelavi obraza na tuje telo. Ko so se taki posnetki lani prvič znašli v spletu, so uporabnike presenetili prav zaradi lahkote rabe in prepričljivosti končnih izdelkov.

Raziskovalec umetne inteligence Alex Champandard je decembra 2017 za spletno mesto Motherboard pojasnil, da so tehnološke ovire za produkcijo takih posnetkov skoraj izginile. »Ob pomoči programske opreme in današnjih zelo zmogljivih grafičnih kartic lahko take lažne videoposnetke izdelamo izredno hitro,« je opozoril in nadaljeval, »da so zaradi dostopnosti gradiva in hitrosti produkcije lažni pornografski posnetki ena od tem, ki zahteva široko javno razpravo in čimprejšnjo regulacijo.«

Z njim se strinja Deborah Johnson, profesorica etike na univerzi Virginia, ki opozarja, da bo vedno hitrejši napredek algoritmov in tehnologije za produciranje takih posnetkov povzročil velik družbeni problem. »Dejstvo je, da tehnologija ni več dostopna samo filmskim studiem, temveč jo lahko uporablja vsak, kar pomeni, da bo takega lažnega gradiva v spletu zelo veliko,« razlaga.

Poleg tehnologije pa ne manjka niti grafičnega gradiva, potrebnega za generiranje lažnih slik in posnetkov. Če samo pomislimo, da so ljudje na oblačno storitev Google Photos v letih 2015 in 2016 naložili več kot 24 milijard selfijev, ki jih lahko uporabimo za algoritemsko manipulacijo fotografij in posnetkov, lahko hitro ugotovimo, da je duh dokončno ušel iz steklenice.

Algoritem je najboljši prijatelj »fake news«

A algoritmsko generirane vsebine ne bodo vplivale samo na našo zasebnost in erotično domišljijo, temveč imajo lahko negativen vpliv tudi v geopolitični areni. »Predstavljajte si, da po spletu zaokroži lažen posnetek ameriškega predsednika Donalda Trumpa, ki napove vojno Severni Koreji,« za publikacijo The Outline začenja scenarij profesor računalniških znanosti Hany Farid.

Da zadeva ni samo domena katastrofičnih scenarijev hollywodske industrije, govori primer iz Pakistana, kjer se je na lažen posnetek pakistanega obrambnega ministra, v katerem je ta pojasnil, da je Izrael Pakistanu zagrozil z jedrsko vojno, odzval uradni pakistanski vir obrambnega ministrstva in odgovoril na lažno izraelsko grožnjo.

Farid nadaljuje, da je zaznavanje lažnih posnetkov vedno težje, hkrati pa je problem v financiranju takega početja. »Google in Facebook ne razvijata orodij za prepoznavanje lažnih vsebin, temveč vse prepuščata akademiji in posameznikom, ki nimajo tako velikih proračunov za boj proti lažem,« je opozoril, »to pa lahko dodatno vpliva na še večjo hitrost širjenja takih vsebin.«

Tudi pravna stroka še ne pozna odgovora na vprašanje kršitev zakonodaje pri objavi t. i. deep fakes posnetkov. Ena od glavnih ameriških pravnic, Mary Anne Franks, ki je sodelovala pri pisanju večine ameriške zakonodaje, ki kriminalizira maščevalno pornografijo, opozarja na katastrofalne posledice. »Težava pri deep fakes je namreč v tem, da jih lahko označimo kot umetnost, obenem pa bi lahko ustvarjalci trdili, da gre za parodijo. Dodatno vse skupaj zaplete to, da žrtev na posnetku ne nastopa s celotnim telesom,« pojasnjuje.

Kakšne so rešitve?

Tako kot pri vseh problematičnih spletnih vsebinah so na prvi bojni črti proti ponarejenim pornografskim posnetkom spet posredniki s svojimi globalnimi platformami. Po pritisku strokovne in laične javnosti se je večina njih (Reddit, Pornhub, Discord, Twitter in drugi) odločila, da bo ponarejeno pornografijo preprosto izbrisala in ne bo dopustila, da se širi po njihovih omrežjih.

discord.png, pornhub.png, reddit.png, twitter.png; Kar nekaj znanih imen spletne scene se je odločilo, da bo ponarejeno pornografijo na svojih straneh prepovedala. Ali bo to dovolj, trenutno ni jasno.

Predstavnik omrežja Twitter pojasnjuje, da pornografski ponaredki jasno kršijo njihove pogoje rabe omrežja v delu, kjer govorijo o »prepovedi širjenja intimnih posnetkov, ki niso bili narejeni za širjenje«. Tej definiciji se pridružujejo tudi PornHub in druga omrežja za širjenje videoposnetkov in animacij.

A to seveda ni dovolj. Javno izpostavljanje takih vsebin bo nekoliko zamejilo njihovo širjenje in normalizacijo takega početja, a še vedno se lahko problematične vsebine širijo po drugih, manj javnih kanalih. Elektronska pošta, zasebna sporočila in druga komunikacijska orodja, ki temeljijo na zaprtih skupnosti in jih je težko zaznati, če nisi ravno neposredni prejemnik.

Cathy O’Neill, avtorica knjige »Weapons of math destruction« in ena glasnejših nasprotnic neracionalne in čezmerne rabe velikih zbirk podatkov, v tem vidi trenutek za medijsko vzgojo. »Dokler bomo kot družba nekritično povzemali medijske vsebine, do tistega trenutna nas bodo algoritemsko producirane vsebine šokirale,« je pojasnila za Vox in opozorila, »da bi se morali zavedati nevarnosti velikih zbirk podatkov, ki so osnova za manipulacije in zlorabe.«

Algoritem proti algoritmu

Predstavniki podjetja Neva Labs so prepričani, da se je proti algoritmov mogoče boriti tudi z algoritmi. Razvijajo namreč orodja, ki bi na področju množičnih medijev in novinarstva spet vzpostavila normalen odnos z občinstvom.

Vedno večje število uporabnikov namreč zaradi algoritemskega prilagajanja vsebin v spletu sploh nima dostopa do celotnega spektra medijske ponudbe, hkrati se med novicami velikokrat znajdejo tudi laži in ponaredki.

Ustanoviteljica Áine Kerr poudarja, da jih čaka veliko delo. »Opazili smo, da si uporabniki želijo boljši nadzor nad pretokom vsebin v spletu in da tega trenutno nimajo,« pojasnjuje, »zato se trudimo razvijati algoritemska orodja, ki bodo uporabnikom pomagala prepoznavati laži in bodo obenem ponujala relevantnejše in kakovostnejše vsebine.«

Alexander Reben, umetnik in inženir, ki je na problem algoritmov opozoril s filmom »Deeply Artificial Trees«, v katerem je algoritem naučil risati podobe v slogu znanega slikarja Boba Rossa, je za Vice pojasnil, da bo razvoj algoritmov vedno hitrejši in da bo stroj sam sposoben vedno več.

Glede boja algoritmov z algoritmi, kjer bi raziskovalci algoritme programirali, da bi nato lahko »lovili« ponaredke, je skeptičen. »Vse skupaj bi vodilo v oboroževalno tekmo, samo da bi tu namesto z orožjem tekmovali s kompleksnostjo algoritmov in kompleksnostjo prepoznavanja lažnih vsebin,« opozarja.

Temu mnenju se pridružuje Jay Rosen, eden najbolj znanih medijskih teoretikov na svetu. »Sicer stroje res lahko naučimo prepoznavati laži in jih s tem vključimo v boj proti lažnim vsebinam,« pojasnjuje, »a nam to ne sme biti končni cilj.« Rosen za ključno napako pri algoritemskem boju proti lažem izpostavlja preveliko osredotočanje na proizvodnjo lažnih vsebin. »Veliko preveč se ukvarjamo z omejevanjem dosega lažnih vsebin, nihče pa se ne sprašuje, zakaj se te vsebine tako lahko širijo in zakaj jih ljudje pravzaprav hočejo,« opozarja.

Moralna plat tehnologije

Nič čudnega torej ni, da se sektor informacijske tehnologije vedno bolj ozira po bolj družbenoslovnih in političnih rešitvah problema podivjane tehnologije. Ena od rešitev je predlog tehnološke Hipokratove prisege.

»Razvijalcem je treba jasno povedati, da lahko protestirajo, če ugotovijo, da gre njihovo delo v napačno smer,« je prepričan DJ Patil, vodja oddelka za podatkovne analize v uradu nekdanjega predsednika Združenih držav Amerike, Baracka Obama. »Ker smo trenutno v otroštvu nove dobe, je časa še dovolj, da zastavimo okvire etičnega delovanja in se zavežemo, da jih bomo spoštovali,« je še dodal.

Skepsa na tem področju je seveda velika. Kritiki opozarjajo, da je utopično pričakovati moralno delovanje od podjetij, ki denar služijo točno s takim delovanjem, kot ga obsoja deklaracija. Obenem aktivisti opozarjajo, da so deklaracije večinoma namenjene metanju peska v oči, saj lahko podjetja s problematičnim delovanjem nadaljujejo tudi po podpisu nezavezujoče deklaracije.

Veliko boljša je zavezujoča pravna zakonodaja. Aktivist Aral Balkan pojasnjuje, da je aktualna regulativa GDPR veliko boljša od etičnih zavez industrije. »Na področju varovanja osebnih podatkov se je treba ukvarjati z zakonskim omejevanjem obdelave in zbiranja velikih količin takih podatkov in industrija, ki služi s tem, ni pravi naslov za vzpostavljanje etičnih dogovorov,« je kritičen.

Drugi raziskovalci razmišljajo podobno. »Inženirji in snovalci umetne inteligence in algoritmov ne smejo biti tisti, ki določajo, kako se bodo ti algoritmi uporabljali,« je na srečanju Etike in umetne inteligence pojasnila Terah Lyons, direktorica nevladne organizacije »Partnership on AI«, ki se ukvarja s tem problemom. »Potreben je širok konsenz družbe, politike in industrije,« je še dodala.

Vesolje algoritmov

Če se želite na lastne oči prepričati, kako daleč sta umetna inteligenca in algoritemsko ponarejanje videoposnetkov, se sprehodite po spodaj naštetih video vsebinah. Od zabavnejših remiksanj Nicholasa Cagea v klasike svetovne filmske umetnosti do bolj problematičnega kopiranja svetovnih politikov.

• Obamov govor - bit.ly/obamin-govor

• Nemški znanstveniki nadzirajo Putinov govor - bit.ly/putinov-govor

• Nicholas Cage, kompilacija ponaredkov - bit.ly/cage-govor

Če pa bi radi videli, kako strojno učenje poteka v živo, je pravi naslov za vas bit.ly/uci-stroj.